«Headline

Author

澤口 耕太

広範な知識で国内セールスから海外折衝、Web構築まで業務の垣根を軽々と超えるフットワークを発揮。ドラマーらしからぬ類まれなタイム感で毎朝のROCK ON PROを翻弄することもしばしば。実はもう40代。

We want more Atmos!〜Dolby Atmosコンテンツ制作の最前線〜

Apple Musicの空間オーディオ対応などによりいよいよ一般ユーザーに立体音響を届けられるようになってきた。Proceed Magizineでは、これまで空間オーディオに関する技術的な内容を何度か紹介してきたが、この状況の中で実際にどのような音をユーザーに届けるのかという中身の部分について、深田 晃氏、戸田信子氏、陣内一真氏、古賀 健一氏、murozo氏という様々な分野で活躍されている皆様の制作最前線を伺った。Dolby Atmos制作の舞台裏からAtmos Musicの未来まで、大いに盛り上がりを見せた座談会の様子をお伝えしていく。

●ご参加者様:プロフィール

深田 晃

レコーディングエンジニア

CBS/SONY録音部チーフエンジニア、NHK放送技術局・番組制作技術部チーフエンジニアを歴任。あらゆるジャンルの音楽に関わるが、主にオーケストラレコーディングを担当。1997年、AES NYで「Fukada Tree」を発表後、多くのサラウンド番組制作・国際共同制作に関わる。 2011年 dream window inc. を設立、アーティストCD、映画のスコアリング、クラシック音楽録音、マルチチャンネル音響作品制作や空間音響デザイン行っている。AES Fellow IPS 英国放送音響家協会会員 、JAPRS 日本音楽スタジオ協会理事、米国レコーディングアカデミー(グラミー)会員、洗足学園音楽大学 音楽・音響デザイン客員教授。

戸田信子 x 陣内一真

COMPOSER | MUSIC DIRECTOR| SCORE PRODUCER

東京・ロサンゼルスを拠点とした作曲家ユニット。

2003年、バークリー音楽大学の映画音楽作曲科と現代作曲&プロダクション科を卒業した後、ゲーム「メタルギアソリッド4」でタッグを組み音楽制作をスタート。オーケストラレコーディングとハリウッドの映画音楽制作におけるプロダクションノウハウを学び、2011年サウンドトラックに特化した音楽プロダクション「FILM SCORE LLC」をロサンゼルスに設立。エレクトリックなサウンドデザインとオーケストラとを組み合わせたハイブリッドの音楽制作をLAにあるハンスジマーのラボ「リモートコントロール」の制作チームと共に進めている。ロサンゼルス、ロンドン、プラハなどの海外オーケストラの収録経験も多く、さらにフィルムスコアリングを用いた作曲手法を使い、映像と音楽をフィットさせ相乗効果をあげる音作りで全世界向けの映画、アニメ、ゲーム音楽を手掛けている。マイクロソフトのゲーム「Halo 5」のサントラでは初登場で全米ビルボードのサウンドトラックTOP2入りを果たすなど、近年目覚ましい活躍を続けており、これまでにゴールデンリール賞(MPSE)の長編外国語映画部門音響編集賞や英国アカデミー賞ゲーム部門音楽賞など、様々な音楽賞を受賞している。

主な代表作:『メタルギアソリッド4 ガンズ・オブ・ザ・パトリオット』『太秦ライムライト』『Halo 5』『ULTRAMAN』『攻殻機動隊SAC_2045』『スター・ウォーズ:ビジョンズ 』など多数。

古賀 健一

レコーディングエンジニア

レコーディング・エンジニア。青葉台スタジオに入社後、フリーランスとして独立。2014年にXylomania Studioを設立。これまでに チャットモンチー、ASIAN KUNG-FU GENERATION、Official 髭男dism、MOSHIMO、ichikoro、D.W.ニコルズなどの作品に携わる。また、商業スタジオやミュージシャンのプライベート・スタジオの音響アドバイスも手掛ける。

murozo

レコーディングエンジニア

Crystal Soundを拠点に活動する気鋭のレコーディング・ミックスエンジニア。超特急、TAEYO、week dudus、Sound’s DeliなどHIPHOP、R&Bからポップスまで様々な楽曲制作に携わり、Dolby AtmosミックスにおいてはSySiSY「Weekend」、Lil’Yukichi 「May I… feat. antihoney」などメジャーからインディーまで幅広く手掛けている。

ROCK ON PRO(以下、R):本日はお忙しい中お集まりいただきありがとうございます。さっそくですが、みなさまそれぞれの「Atmos事情」のようなものあれば伺いたいのですが。

戸田:Netflixが納品形態としてAtmosを推奨していることもあり、実際にAtmos制作に関わる機会は多くなっています。ただ、劇伴音楽という立場からすると、Atmosによって得られる「空間」は効果音で自由に使ってもらう、というスタンスでいるほうがよい結果になると思っています。特殊な効果以外では頭上から音楽が聴こえる必然性はないですし、逆に見ている方を混乱させてしまうことにもなりかねない。そうではなくて、作品の効果を高めるためにどうやって「空間」の中で効果音と共存していくか、ということを考えることが多いですね。

深田:映画の場合は、音楽と効果音の役割分担というものがありますよね。最近関わらせてもらったある映画作品で、少年合唱団が歌うシーンがあって、それは高さが追加されることで7.1chよりもさらにドキドキする、引き込まれるシーンになったなと思っています。

戸田:オブジェクトトラックを使って音楽を動かす、ということはありますか?

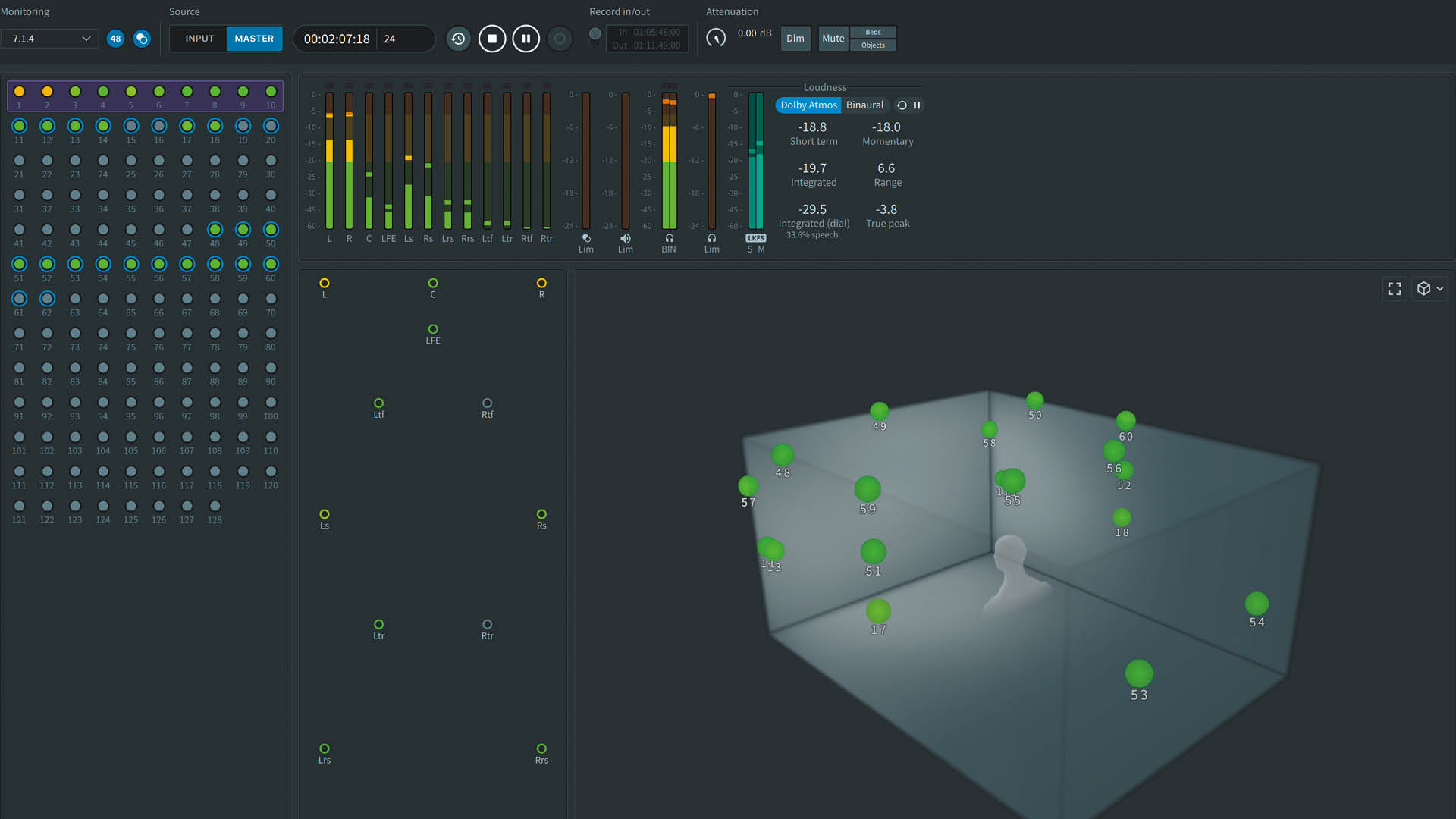

古賀:今のぼくのデフォルトのセッティングでは、20個のオブジェクトトラックが常に立ち上がってます。9chのワイドチャンネル用、トップフロント用、トップリア用のセンドを6チャンネル分作ってるんです。あとはSpat Revolutionで9.1.6のリバーブを作って常に送り込んでたりするので、その分はオブジェクトを使いたいって感じですね。でも、別に動かしたいわけではなく鳴らしたいだけ。まだ映画でAtmosをやってないんですけど、たぶんセリフの関係とかで音楽がワイドチャンネルに逃げなきゃいけない場面ってあると思うんです。そのために、それくらいのオブジェクトは必要なんじゃないかなって。ただ、オブジェクトの使い方は難しいな、と。逆に聞いてみたかったんですが、劇伴では音楽に何チャンネルくらいのオブジェクトトラックをもらえるんですか?

戸田:基本的にはベッドのみで、オブジェクトは使わないようにしてます。劇中ではなくオープニング / エンディングとかでオブジェクトを使って音楽を聴かせる、という使い方をする場合はあるんですけど。その時はステムからオブジェクト化して、Atmosにした場合の効果をエンジニアさんと確認しながら制作したんですが、それは全スピーカーを音楽だけに使えるからやれることで…。もちろん、新しい使い方は模索してるんですが、現時点では劇中で音楽を回したり、というのはやはり無理なので、考え方としてはサラウンドから空間をさらに広げるという形になっていますね。

R:ハイトチャンネルからの音ってどんな使い方をするんですか?

戸田:ビックリさせる効果を出すために使ったりしました。テーマソングがついてる敵キャラがいるんですけど、登場シーンでその歌を上から降らせたりとか。攻殻(註:Netflix『攻殻機動隊 SAC_2045』)だと、ハイトを使ったのはそれくらいですかね。ハイトはやはり主に効果音が使ってました。

古賀:効果音をハイトから出す時って、プラグインで広げたりしたんでしょうか。

陣内:いや、それ用のパンニングと空間処理でやってたと思います。効果の方は正確にはわからないですが、音楽に関しては今回ほとんどがシンセだったので、ものによってはプラグインで広げちゃうと音がスカスカになってしまう。なので、基本的にはパンニングでちゃんとその位置に持ってく、という形でしたね。

古賀:Atmosの仕込みはどうやってますか?

戸田:仕込みはうちのスタジオでやってます。11月公開の劇場版(註:2021年11月12日〜25日に上映された『攻殻機動隊 SAC_2045 持続可能戦争』)の場合は、すでにNetflixで使用したデータをサラウンドのステムで用意してあったので、それをバラしてAtmosにミックスし直しました。12話あったものを2時間にまとめてるのでほぼ付け替えでした。

古賀:Atmosのままとっておくわけではないんですね。

戸田:Atmosのステムだと5、60GBになるわけですよ。データで送るのもままならない(笑)

古賀:2時間映画だと、何日くらいダビングステージ(註:映画制作で、ファイナルミックスを行うスタジオ)に入られますか?

戸田:向こうだと、普通は2週間はあります。その代わり、終わっても白紙に戻されることもありますよ。

陣内:ダビングまで終わった映画のオープニングを作り直さなきゃならないとか。「スタジオでアシスタントが準備してるから今すぐ行って。午後から監督レビューだから。」とか言われて(笑)

戸田:とある番組では、監督OKまで出てあとは確認チェックだけっていう段階から「これニュースの音楽みたいだから変えて」とか。一週間ダビングしてあともうちょっとで終わるってところで、家に帰って音楽作り直しましたよ(笑)

R:日本だとダビングにそんなに時間は割いてもらえないですね。

戸田:そういう点では私たちの環境は恵まれていて。『攻殻機動隊 SAC_2045』はCGの制作ペースに合わせる形で、1ヶ月で2話のペースで制作してたんです。映像に合わせてイチから作ってプレゼンして…「違う」って言われてまた戻る、みたいな(笑)。12話作ると半年なので監督の好みとかもわかってきてすごくやりやすかったです。

陣内:やっぱり、シーンに合わせて書けた方が楽です。効果のガイドももらえたんで、それに合わせて引くところは引くということもできたんで。

R:今回の攻殻はじっくり見させていただいたんですが、音楽と効果音が入れ替わり立ち替わりで場面を作っていくような作品という印象でした。

戸田:ありがとうございます。監督が、もともとフィルムスコアリングをやりたかったという方なので、そういう音になったのかもしれません。今回の作品は展開が激しくて、これはたぶん選曲(註:新たに作曲せず、既存の曲を使用すること)ではできなかったな、って(笑)

陣内:Atmosということで言うと、あらかじめ曲ができていて後からそれを「Atmosで」っていうよりは、全体の音響に対してちゃんと曲をデザインしていける方が効果的なのかなって、ダビングをしていて思いましたね。例えば、10分間バトルし続けるシーンがあったとして、既存の曲を10分間ループさせるわけにはいかないですから。

古賀:最終的なビジョンを共有していることはすごく大事ですよね。

戸田:特にAtmosだと、効果音がどこから鳴るかだけじゃなくて、効果音の種類とかでも世界が変わっちゃうじゃないですか。シリアスな音楽を作ってきたのに効果音はコミカル、みたいになると全然違うし。そういうことをちゃんと打ち合わせできた方がいいですね。

古賀:効果音がすごく低音を出してきたりすると、「この曲、ベース要らなかったじゃん」みたいになっちゃう。

戸田:BGMが邪魔になっちゃいますからね。

陣内:実際、一番下の音域の使い方は結構気を使いますね。いたるところでドーン!と来るわけにいかない、というか。

戸田:カークラッシュのシーンとか、効果音からすれば一番「ドーン!」といきたいところじゃないですか。そういうシーンでは、キワまで音楽でガァーっと盛り上げてパッ!と逃げる、みたいにするんですけど…たまに効果も逃げちゃって「シーン…」みたいな、「え?新しい演出??」みたいなことになることもあります(笑)

古賀:ピクチャーロック(註:以降、映像に変更がない状態のこと)はあるんですか?アニメだと、あとから映像を変更できるじゃないですか。

戸田:ピクチャーロックは大前提ですね。

陣内:効果のタイミングは特にそうですね。

戸田:シーンごと変わったりしない限り音楽はある程度は対応できますけど、効果音は数フレーム違うだけで気持ち悪いことになっちゃいますから。

R:いわゆる音楽作品の場合はいかがでしょう?

古賀:やっぱりAtmosと相性がいいのはライブものなんですよね。「今回はAtmosでやってみませんか?」っていう提案も、ライブものだと受け入れてもらいやすいです。

R:やっぱりライブ空間を再現する、というのは方向性として分かりやすいですよね。

戸田:やり方としては、コンサートとかライブを収録して再現する方向にした方が、絶対Atmosの良さは生かせますよね。アイドルグループが映画館を貸し切ってAtmosでライブビューイング中継やったりしてますけど、実はあの方向が一番効果的なのかなと思ったりします。

深田:Atmosになって変わったことというと、客席後方に立てていたマイクは使わなくなりましたね。今までは客席で聴いている音場を意識していたんですけど、Atmosになってからは指揮者のあたりをリスニングポイントとして意識するようになりました。以前のフロントLRが、サイドチャンネルに近くなる感じです。立体音響になることでオケに寄っていっても違和感がないように感じます。

R:マイクのお話が出たのでお伺いしますが、Atmos制作にあたってレコーディングに変化はありましたか?

古賀:ぼくはAmbisonicsマイクを立てまくってます。Atmosに使わなくても、2chのアンビとか、あとで何にでも使えますし。ただ、スタジオのメンテがちゃんとしてないといけないんですよ。Ambisonicsだと、1チャンネル録れてなかったら全部ダメになってしまう。4チェンネルのレベルもきれいに揃わないと位置情報がずれるので、HAも精度の高いものが求められます。その辺は悩ましいと思いつつ、スタジオのメンテナンスをするモチベーションと捉えてます(笑)

深田:Atmosになって「ハイトが追加された」と考えると、メインLRの真上に置くとしても、AB、XY、ORTF…組み合わせは無数にあるじゃないですか。そういうものをいろいろと実験してはいますね。

R:サラウンドの時のように新しいアレイが発表されるでしょうか?

深田:AESではいろいろ出てるみたいですよ。ただ、ハイトにマイクを立てるとなると、ミドルレイヤーの音がハイトのマイクに入ってしまうという問題が起こるんです。だから、理屈で言えば単一指向の方が向いているっていうことになるんですけど、そうすると、マイクの距離をどうするかという話にもなる。でも、いろいろ試した結果ではそこはあまり大きな問題にはならなそうでした。

R:まずは「ハイトのマイクがある」ということが重要、ということですね。

深田:そうですね。それと、単一指向の方が中心周波数が高いところにあってクリアーな音になるから、そうした意味でも単一指向の方が立体音響に向いているという理屈になるんですけど…聴いた感じは全指向の方が好きだったり、いろいろ難しいですね(笑)。ぼくはメインのLRマイクの上に立ててるやつは単一で、オケの中で録ってるマイクは全指向にしてます。

古賀:ぼくはホールでは三点吊り(註:ステージ上方にマイクを設置するためのワイヤー機構)にAmbisonicsマイクを立ててます。これにメインのLRマイクを足して、芯はメインでしっかり録るって感じです。三点吊りに複数のマイクをちゃんと設置するのって難しいじゃないですか。何度もやり直すとホールのひとに怒られちゃうので(笑)Ambisonicsマイクはカプセルの位置が固定されてるから、その辺の心配がない(笑)客席とステージ上にも使って、Ambisonicsマイクを3本使ってます。

R:Atmos制作ならではの難しさみたいなものはありますか?

戸田:打ち込み制作の限界について、強く感じますね。攻殻のようなSF作品だとサンプルライブラリのようなものを使用する機会も多いんですが、もともとAtmosミックスを前提に収録されていないものが多いので、Atmosの良さを活かしきれていないと感じることがあります。なので、生オケを収録するような場合ははじめから各マイクを各スピーカーに当てられるような配置で演奏を録る、アンビエンスを録る、というようなこと目指してます。

陣内:市販のサンプルライブラリだと、ステレオまでしかないというものも多いですが、それだとその時点で選択肢から外れちゃう。少なくともクアッドで鳴らせるサンプルが必要です。それでも、5.1chの時はまだよかったんですけど、7.1.2chになると音が空っぽすぎるので、メインのほかにルームマイクが収録されているようなライブラリだったらそれも全部立ち上げたりして…なんとか疑似的に作ってはいたんですけど。

戸田:ルームとメインとサラウンド…

陣内:それとスポット。各楽器でそれがステレオで4本ずつ、となると結構データ量がかさんじゃって。

戸田:そうなると、何百トラックも使うような音楽は扱えなくなっちゃうんですよ。特に、96kHzとかで収録してさらにマイクの本数が増えると大変なことになってしまいます。どちらかというと、機材やツールのスペック的なところがまだAtmosに対応できてない部分があるように感じます。Atmosで使用することを前提にした音源も全然少ないですし。

陣内:いまのぼくらのセットアップでいうと、ウッドウィンドとストリングスはAtmosフロント / リアのチャンネルがあるライブラリーなんですよ。けれども、全部立ち上げるとちょっと…音が鳴らなくなっちゃうので(笑)サンプル用のPCが1台1セクションみたいな…ストリングスで1台、ブラスで1台、みたいな感じになっちゃってます。

古賀:昔のGIGA STUDIO時代に戻ってるみたいですね(笑)

陣内:音源のコアのクオリティみたいなものが、顕著に出てくるんです。ソフトシンセにありがちなエフェクトで音ができているようなものだと、リバーブを切ると全然楽器の音にならずに使いものにならないんですよ。リバーブもステレオでかかっちゃってるし。なので、原音がいいシンセに限定されてくるという印象です。書き出す時も、ディレイやリバーブは別系統で出して、ドライはドライで残っている状態で出さないといけない。

深田:そう考えると、生でやった方が楽ですね(笑)

戸田:ほんとにその通りです!

R:Apple MusicやLogic ProのDolby Atmos対応についてはいかがでしょう。

Murozo:シェアが大きいApple MusicがDolby Atmosに対応したのは大きいと思います。

古賀:ぼくらエンジニアは、どこか馴れちゃってる部分があると思うんですよ。リスナーの方が「理由はわからないけど、明らかにこれまでの音楽とは違う!」って、気付いてる印象があります。特に若い子たちは、そういう新しい表現を貪欲に受け入れてくれてるように見えます。

Murozo:海外と比べて日本のスタートが大きく遅れたわけではないので、海外よりもいいものを制作することもできる大きなチャンスだと思っています。当初は過去作をアップミックスしただけのようなものも多かったですが、最近はAtmosを前提にしたいい作品が出てきているようにも思います。

古賀:すごく熱心な方もいて、昨日も「Atmosはすごくいいから、これでうちのアーティストも出したいんだ!」って方がうちのスタジオに来てくれて。そういうひとたちってやっぱり世界を見てて、「世界のプレイリストの中に並べたら、絶対この子のよさに気づいてもらえる」っていう熱い想いを持った方なんですよ。

戸田:ステレオマスターをプラグインでアップミックスしただけのような作品ばかりになってしまうと、Atmosの良さがうまく伝わらないんじゃないかというのは心配ですね。さっきのサンプル音源の話と同じで、ステレオ前提で録ったものをAtmosにしようとすると、ないものをあるように聴かせるためにいろんな無理が出てきてしまう気がします。これからAtmosの新録作品がどんどん出てくることに期待します。

R:LogicがAtmos対応したのも大きなニュースですね。

Murozo:作家さんが「ちょっとやってみようか」でパッとできるところまで来たということですからね、どんどん挑戦したいです。

古賀:Atmosミックスは難しい、みたいに思っている方もいると思うんですけど、ステレオの方がはるかに難しいですよ。ちゃんと録音しておけば各チャンネルに置くだけで終わりですからね。

R:実はステレオほどシビアなレベル管理は要らないんですよね。

深田:5.1chの時って、スイートスポットからちょっと外れると、リアから出してる音なんか特にすごく不自然に聴こえましたよね。それが、Atmosでは高さ方向があるせいか、そういう状況でもあんまり変な感じにはならないというか…スイートスポットが広がった、という印象がありますね。

古賀:円の外に出て聴くのが楽しくて好き(笑)「あー、半球状だな〜」って思います。

Murozo:円の外で聴いた時に違和感がなくなったら「できたな」って判断してます(笑)

古賀:サウンドトラックについてはどうですか?

戸田:Atmosで配信できるようになって、制作したフォーマットのまま聴いてもらえるようになったのはよかったですね。ただ、それがどういう環境で聴かれてるか、っていうことに関しては逆にわからなくなっちゃうわけで。ステレオを作らなきゃいけない時は、もうダウンミックスですね。

陣内:本来なら、ステレオはステレオのバランスがあるので、別途ミックスしたいですが。

深田:ぼくは5.1chや7.1chとは別に、もう一度ステレオ用のミックスを作ります。作品にもよると思うんですけど、映像作品の音楽って短くなりがちで楽曲として成立しにくいものがありますよね。いまよく一緒に仕事してる作家さんは作品の中で使用されているのとは別に、楽曲として成立する尺のあるバージョンを作曲したりしてますね。

戸田:挿入歌はそういう作り方をしたりしますね。劇伴として使う以上の尺で、2ミックスも別に用意したりします。

深田:ヘッドホンとスピーカーの互換性については、すごく考えさせられます。オブジェクトトラックにしちゃうと、スピーカーのないところは全部ファンタムになるわけですよね。そうすると、ヘッドホンで作ったものを映画館で再生すると「ちょっと違うな」って感じになっちゃう。映画作品だと効果音がいっぱいあってすごく立体感があるように感じるんだけど、音楽だけだとそれほど(立体音響の)効果が感じられないんだよね。だから、最近はあんまり複雑にせずにやろうかな、と思ってるんですけど。

古賀:そう。東映のダビングステージにはじめてAtmos作品を持って行った時に結構ショックを受けて…。映画って7.1.2chなんで、自分が思ってたよりハイトチャンネルの幅が狭かったんです。サイドスピーカーの位置も思ってたよりも上にあるので、要は「ハイト」って思ってた範囲がより狭い。劇場中を回ってるイメージで作った音が、全然回ってなくて、ガッカリして帰ってきたっていう経験があります。(一同:笑)

古賀:それ以降、Atmosの音場が「半球体なんだ」ってことをすごく意識するようになりました。上側の空間っていうのはサイドに比べるとすごく狭い。Appleの空間オーディオの話で言うと、あれもやっぱり半球体だし、イヤホンなんかで聴くと後ろの音は小さくなっちゃうって感じます。それに、バイノーラルにするとショートディレイみたいなものがかかっちゃうんですけど、それを嫌う方もいる。それを避けるには、Ls/Rs(サイドに配置されたL/Rチャンネル)に音を置いちゃうのがよくて、海外のミックスとかでは歌がLs/Rsから出てるものが増えてきてる。ただ、それをやるとスピーカーで聴いた時に破綻するから、最初に「ヘッドホン特化型にしますか?」ってことは必ず確認してます。

Murozo:それで、センターがない楽曲が増えてるんですね。

古賀:LFEもセンターも使わない、メインのパートはLs/Rsにある、っていうヘッドホン特化型のミックスも出てきてますよね。バイノーラルにすると、それが結構バランスがいいんです。Atmosだとモノラル表現ひとつとってもいろいろな方法がある。ハードセンターのモノラル、LRファントムのモノラル、上のチャンネルを使ったモノラル…ヘッドホンで聴くと全部違って聴こえるので、3パターンくらい作って「どのモノラルが好きですか?」って聞いたりしてる。

R:実は、そこがみなさんに一番聞きたかったことで。配信コンテンツやApple Musicのようないまの空間オーディオって、たぶん9割以上の方がヘッドホン / イヤホンで聴くことになると思うんです。下手したらNetflixもそうですし。でも、制作者側はスピーカーで作っていて…。そこの差分はどうやって埋めてますか?

Murozo:ぼくはひたすらスピーカーと、Air Podsのような空間オーディオ対応イヤホンとの間を行き来して聴き比べてますね。それがいまできる最善の方法かな、と。

深田:バイノーラルレンダリングすると、LRがハッキリしなくなるんですよね。スピーカーの方がそこはちゃんと出るんだけど、ヘッドホンはもう無視できない時代のようにも感じていて。写真を撮るだけで疑似的に耳型が取れるようなイヤホンとか、ヘッドホン/イヤホンもどんどん性能はよくなってくと思うんですよ。いつも言うんですけど、メガネってみんなそれぞれ違うじゃないですか。同じようにイヤホンもパーソナライズするってことをもっと簡単にできる時代が来るんじゃないかな。

戸田:Atmosをステレオにダウンミックスした時に、もともと作ったミックスとだいぶ違うなっていうようなことが起こったりします。なかなかそういうところまで、事前に確認するのって難しいなと感じています。

古賀:いま個人的に思ってるのは、スピーカーのセッティングと調整をちゃんと追い込めば、その差はかなり埋められるということです。実はある時点でその手応えが得られたのでAtmos用のスピーカーを揃えたっていうのがあります。

陣内:なるほど。

深田:Appleの空間オーディオはAtmosの距離パラメーターは反映してないんですよね。TidalとかAmazonは反映してるんですけど。

古賀:はい。その機能がLogicにはついたんで、Appleの今後に期待ですね。

R:ゲームは何年も前からすでにDolby Atmosに対応していますが、ゲーム音楽での制作はどのようなものだったのでしょう?

陣内:『マーベルアイアンマン VR』の時は、オーディオエンジニアの意向もあって音楽はクアッド納品しましたね。頭を動かしたそのまま音楽も動くというものではなかったんですが、人間の頭部をソースにしたモジュレーションを軽くかける、みたいなことをやってました。上に行ったり下に行ったり激しく動くんですが、そういう部分は音楽では表現できなかったので、画面では伝わりにくいスピード感とかを表現する方向にフォーカスした記憶があります。

戸田:ゲームで難しいのが、仮想空間の中をプレイヤーが360°自由に動けちゃうんですよね。すると、じゃあ音楽ってどこから聴こえるんでしょうね??っていう…。結局、効果音は空間で鳴っているけど、音楽だけヘッドホンで聴いてます、みたいな感じになっちゃうんですよ。

陣内:実際、Xbox Oneから7.1.4で出せますよってことで、あらかじめほかのタイトルを聴いてみたら音楽はステレオだったんですよ。それで、効果音と音楽の空間感にすごく差があって…。効果音は空間に広がっているんだけど、音楽はずっと耳元で鳴ってるみたいな。

深田:だいぶ前ですけど、ビョークのVRコンテンツも音はステレオでした(笑)

R:ヘッドトラッキングものはちょっと難しいみたいですね。音楽って、どうしても定位のようなものが必要なんだな、って感じました。

古賀:音楽サブスクリプションサービスの対応は嬉しいんですが、ヘッドホンから先に体験すると「こんなもんか」と思ってしまう人もいるんじゃないかということは心配ですね。先にスピーカーを体験してもらえればAtmosのよさは伝わると思うので、そういう体験の機会が増えるといいですね。

戸田:そういう意味では、やっぱり映画は劇場(=映画館)で見てもらいたいという思いがあるんです。劇場って、作ったものを意図した通りに観せられるという最高の場所のひとつなんですよ。だから、クリストファー・ノーランなんかは、その一回の視聴の中ですべてを体験させることを目指して制作する。それってものすごく高い技術力で緻密に制御されてるから聴けるわけで、音が破綻してたら物語も頭に入ってこない。だから、その作品をしっかり演出できるところまで追い込まないといけない、っていうのは映画をやる上での掟だと思うんですよね。

R:やはり、やる以上はちゃんとしたものを作りたいですよね。

戸田:そうですね。国内でAtmos対応の映画館がやっと3館くらいできた時にインドにはもう60館くらいあって、日本はアジアの中で一番遅れてたわけじゃないですか。Atmosミックスができるスタジオもまだまだ少ない中、せっかく苦労して作っても観られる映画館がないと結局その良さが伝わらないってことになっちゃうんじゃないかな、と。映像の世界もそうだと思うんですけど、設備投資も必要ですし。それをやる必然性みたいなもの…仕事の量とか、Atmosにすることの重要性、あとは周りの声だとかが挙がってこないと、せっかく映画館を作っても外国作品しかないような状態になりかねない。日本も、作品をもっと海外に輸出することを考えれば、予算はちゃんと回るんじゃないかと思うので、ぜひ頑張ってAtmos作品を撮ってほしいですね。

戸田:サウンドトラックを専門的に収録するためのオーケストラを立ち上げたんですが、いろんな企業さんに「ぜひ私のオーケストラを使って実験してください」ってお願いしたことがあるんです。その時来てくださった企業さんがやったのは、指揮者の右手前方くらいにマイクを立てて、客席ではなくステージ上で聴こえる音を立体音響で再現するという内容でした。映像も演奏者が指揮者を見る角度からのもので。それはとても面白かったんですけど、じゃあそれを何に使うのか、というところまでは落とし込めなかったんです。

深田:新日本フィルの配信の時に似たようなことをしました。木管、バイオリン、指揮者、ピアニスト…みたいに固定カメラがいくつかあって、それぞれの目線の音を作りたいという内容でした。それで、Atmosミックスを6パターンも作って(笑)、映像を切り替えると音も切り替わる、っていう(笑)。コロナで配信しかできなくなったので、新しいことにチャレンジする試みのひとつで体験としては新鮮で面白かったんですけど、純粋に音楽を楽しむというのとはやはりちょっと違うかな、と。

R:ついつい、意味もなく回してしまったり(笑)

深田:5.1chの初期の頃がそうだったんですが、新しい技術ができて、ツールが生まれて、いろんなことができるようになるとついつい小手先でいろいろと遊びたくなっちゃう(笑)。そういうことに囚われずに音楽の本質を捉えた上で新しい、という作品がどんどん出てきてほしいですね。

古賀:「配信するとCDが売れなくなるから」とか「ステレオはできてるからアップミックスでいいじゃん」みたいな考えの方も残念ながらいらっしゃるんですよね。そういう方に納得してもらうためにも、よりよい環境でAtmosミックスを聴いてもらえる機会を増やしていかないと、と思います。

戸田:根性論みたいであまり言いたくないんですけど、クリエイター、つまりモノを創っているひとたちが、次の時代を創れるかもしれない可能性が目の前にある時に、そこから手を引くっていうことが私は率直に「やだな」って思っちゃうんですよね。もちろん、いろいろな困難がありますけど、そこをなんとかやりくりしてでも「日本から発信できるすごいものができるかもしれない!」っていうことをモチベーションとしてるはずじゃないですか。たとえ社会的なムーブメントがなくても、「私たちがそういう作品を創ればいいじゃん」って考えるのがクリエーターの使命というか、性だと思うんですよ。

古賀:楽観的な話題だと、Atmosカーっていうのがあるんですよね。この前、富山でAtmosタクシーっていうのに乗ったんですよ(笑)そしたら、NetflixとかAmazon HDが入ってて。開発が進めば車でAtmosを聴けるようになるっていうシチュエーションは激増するんじゃないかと思ってるんです。そうなったら、どうやってAtmosのよさを広めようかなんていう心配は5年くらいで全部解決されちゃうんじゃないか、と。

古賀:生収録の話だと、いま国内にはAtmosで活かせる響きを録れるスタジオが少ないんですよね。

深田:スタジオってもともと響きを録るとか音をリッチに録るというのではなくて、なるべく響かないように、ほかのマイクに音がカブらないようにっていう発想で設計されてますからね。ちょっと響くスタジオって、芸大の千住(東京芸術大学 千住キャンパス)のスタジオくらいですね。あれくらい響くスタジオって国内にはないですよ。

戸田:私が立ち上げたオーケストラも、まさにそれが課題で。一番の問題は日本にはスコアリングステージ(註:劇伴制作用の、オーケストラが収録できる大規模スタジオ)がないっていうことだったんですよ。この前も海外作品の音楽を録っていたんですが、録りたいものを録りたい配置で録れるスタジオがない。仕方がないので、ミューザ川崎、オペラシティ、所沢のミューズとか、ホールにオーケストラを入れて、マイクもいろいろと変えて、いわゆる「映画音楽!」的なトラディショナルなクラシックからハイブリッドなものまで…いろいろと試してるんです。それはそれでいいものが録れるんですけど、スタジオで、クロースマイクで録るような芯のある音、映画で使えるっていうレベルまで持っていくというのは難しくて。

深田:今は(コロナによって)難しいですけど、オーケストラの練習場みたいなところって意外にいいんですよ、それこそスコアリングステージみたいで。遮音板みたいのはないんですけど、スペースとしては全然使える。以前、札響さん(札幌交響楽団)の練習場というところで普通のアルバム用のレコーディングをしたことがあるんですよ。広くて、結構スタジオ感覚で使えたんです。

戸田:卓(音声卓)はどこに置いたんですか?

深田:ぼくは卓はほとんど使わないんですよ。HAからI/Fを介して、そのままPCに入れてしまう。

古賀:モニタリングはヘッドフォンですか?

深田:いや、控え室みたいな部屋をひとつ借りて、スピーカーでモニターします。

戸田:クリックがある時はどうしてますか?いまの劇伴だと、いわゆる「同期もの」を録りたいことも多いんですが、オケが80人規模なのでキューボックスが足りなくて…。

古賀:ぼくも小ホールの録音の時とか、自分で持ってるキューボックスを持っていきますが、やっぱり限界がある。下手をするとキューボックスのためだけに外部の業者さんを呼ばなきゃいけなくなる。

戸田:そうですね。スタジオじゃないので、搬入とセッティングで3時間かかったりとかもあって。そういうことを考えるとどうかとも思うんですが、オーケストラが7、80人の規模なのでスタジオでは録れない…なんとかならないかな、と。

古賀:結論としては、日本にスコアリングステージを作ればいいってことに(笑)

戸田:みんなでお金出し合って作りましょうよ〜(泣)

古賀:それやって死ねたら本望かな、と思ってます(笑)

戸田:結局、日本でできないから海外に行かなきゃいけなくなっちゃうんですよ。プラハとか行くと、それこそAtmosの収録とかもどんどんはじめているんですね。今日話したような音源ライブラリの限界もあって、これからAtmosによって生収録が重要視されますし、LAとかからも劇伴制作の依頼があってすごく盛り上がってるんです。海外の映画とか、Netflixでやってるような作品を日本で収録する…そういう制作を輸出するということをやりたいっていうのが、私のひとつの目標としてあるんです。それができたら、日本のAtmosミュージックはもっと盛り上がるな、って。

R:日本にスコアリングステージを作るというのが、一番いい結論なのかも知れないですね。

戸田:ROCK ON PRO で監修してください(笑)というか、ここにいるメンバーでスコアリングステージ作れるんじゃないですか?(一同:笑)

それぞれに専門分野の異なるプロフェッショナルたちによる座談会らしく、忌憚のない意見が飛び交うものとなった。配信事業の対応によるDolby Atmos体験の裾野の広がりを歓迎しながらも、制作者の意図しない環境で聴かれてしまう可能性を危惧される様子が印象に残っている。一部ではバズワード化しているDolby Atmos / 空間オーディオというテクノロジーを真に豊かなユーザー体験へと結実させるためには、地に足のついた制作・聴取が必要だと感じた。読者の皆さまの身近なところにも制作ツールは数多く存在するようになっている、ぜひその制作を実際に体験してみてほしい。

*ProceedMagazine2021-22号より転載

*記事中に掲載されている情報は2022年02月24日時点のものです。