«Headline

Author

嶋田 直登

[ROCK ON PRO Product Specialist Team / Assistant]2019年4月入社。IT/音響心理学/マルチメディアの基礎知識をベースにProduct Specialist Teamのサポート業務を行なっている。好きなものはリズムマシンとカレーライス。こう見えて実は、泣く子も黙る九州男児。

いま、名古屋のバイノーラル現場がアツい !! 〜テレビ愛知株式会社のバイノーラル生配信レポート〜

ここ数年、名古屋の立体音響制作界隈が実にアツい 。これまでも在名放送局各社によるバイノーラル制作事例もある中、今年3月にはFlux:: / SPAT Revolutionを用いたバイノーラル配信という実験的な取り組みをテレビ愛知が行った。どのような手法でコンテンツを提供していくのか、制作にあたってのキーポイントはどのようなものか、そして一体名古屋で何が起こっているのか。取材班が見た現地レポートをお届けする。

●ライブライブライブ!3日遅れのひな祭り

<番組情報>

<You Tube アーカイブ:ライブライブライブ!(完全ノーカット版)>

アナログ放送が終了し、地上デジタル放送に完全移行して早10年。それに伴って民生向けテレビの画質もフルハイビジョンから4K、8Kと急速に変化を遂げてきた。音に関する技術トレンドは、ハイレゾ音源が普及していく一方で、立体音響へのアプローチが進む。スピーカー配列のバリエーションはステレオから平面のサラウンドになり、そこに高さ方向のスピーカーが加わってイマーシブサラウンド、と年々より臨場感のある音響制作環境へとシフトしてきており、イマーシブ対応のスタジオもここ数年で急速に増加している。

従来、そういったスタジオで制作された本格的な立体音響作品を家庭で楽しむためには、専用のホームシアター環境を整備するほかなかったが、イネーブルドスピーカーやイマーシブ対応サウンドバーの登場により、天井にスピーカーを設置しなくても気軽に楽しめるようになった。しかしながら、日本の密接した住環境を考えると、より多くのユーザーに立体音響を楽しんでもらうにはイヤホンやヘッドホンでの再生ができるようにならなくてはならない。そこで鍵となるのは、もちろんバイノーラル録音・再生の技術だ。技術自体はおよそ1世紀ほど前から存在するが、世間一般的な普及具合はまだまだ伸びしろがあると言ってもいいこの技術。令和の時代を迎え、スマホ+ワイヤレスイヤホンでOTTコンテンツを楽しむ人々が増えたいま、そのポテンシャルがようやく発揮されようとしている。

テレビ愛知の番組「ライブライブライブ!3日遅れのひな祭り」が今年3月に生配信された。当日は名古屋のご当地アイドル10組による無観客ライブの模様を、You Tube Liveと在名民放4局が立ち上げた動画配信サービスLocipo(ロキポ)にて生配信。後日そのダイジェスト版がテレビでも放送されたそうだ。そして、今回テレビ愛知では初となる取り組みとして、バイノーラルステレオ音声での制作が行われた。アイドルのライブを生配信でバイノーラル配信するという実験的な取り組みだが、そのきっかけは一体なんだったのだろうか。

時は遡り昨年秋、テレビ愛知より「近いうちにアイドルのライブ配信イベントを行うので、そこでイマーシブオーディオの制作に挑戦してみたい」という旨のご相談をいただいた。以前より弊社でも行っていたバイノーラル音源のデモやInter BEEでのプレゼンなどが印象に残っており、イマーシブ制作に触れられるタイミングを窺っていたそうだ。そこで、どういった方法で音をバイノーラル化するかといった部分から検討がスタートし、各種製品検討の結果、直感的にわかりやすいGUI、そしてMACでのPro Toolsとの連携ワークフローの親和性から、Flux:: / SPAT Revolutionを使用することになる。このSPAT Revolutionでは、スピーカーを360度の仮想立体空間上に自由に配置し、任意のスピーカー配列向けに出力できるほか、バイノーラル処理して出力することも可能だ。今回はこのSPAT Revolutionからのバイノーラル出力を配信ミックスを行なっている卓に戻し、各配信エンコーダーへ渡すという手法をとることになった。

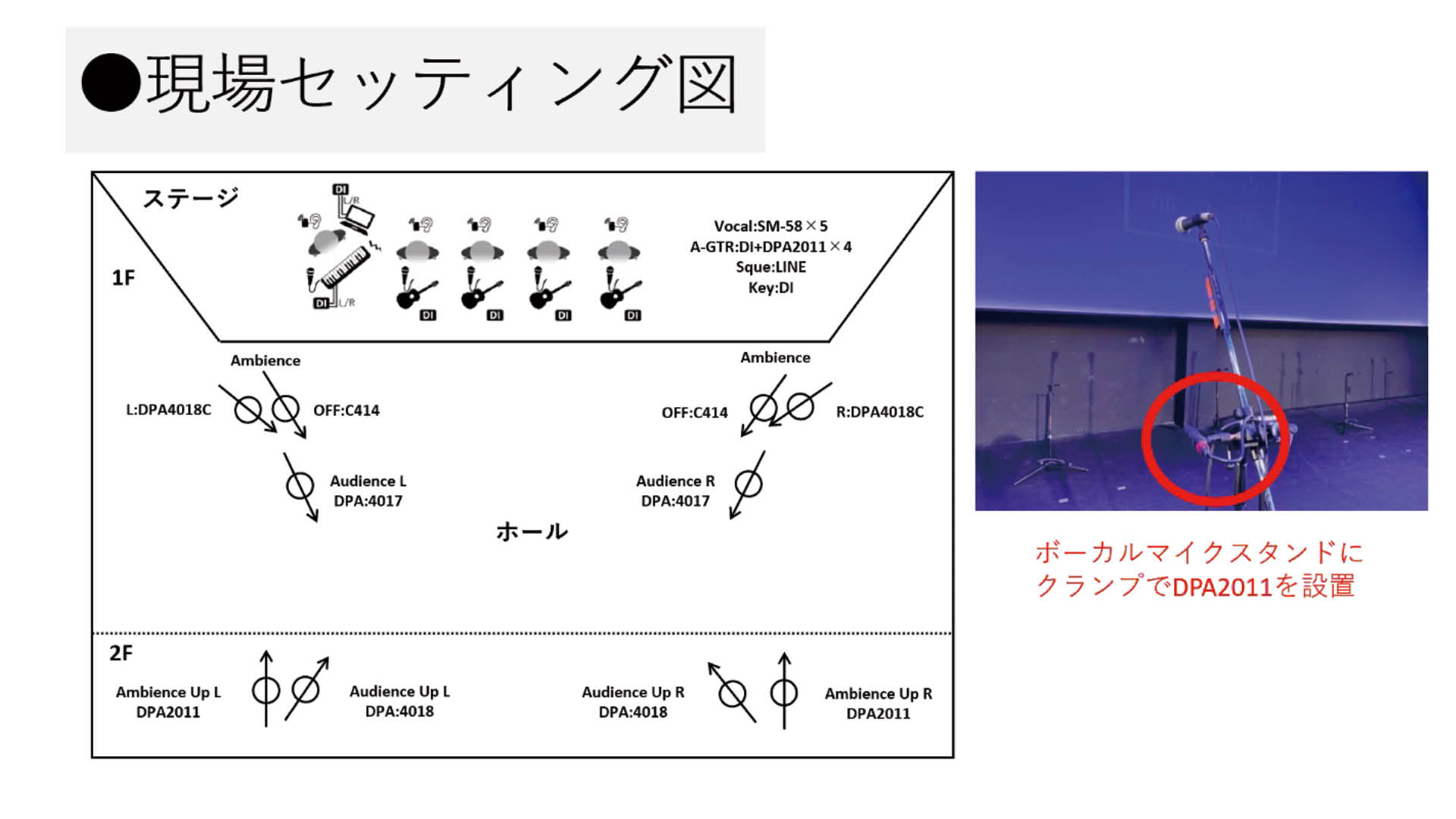

そこでまず課題となったのが、元々のステレオミックスのオケからどのようにして立体感を演出するかということ。そのためには、SPATの仮想空間上で左右上下に広く空間をとって音源を配置し、広がりを感じさせるように仕向ける必要がある訳だが、ここに関してはボーカルの配置と会場のアンビエントの組み合わせで対応した。まずボーカルの配置については、出演者のハンドマイクを仮想立体空間上にアーチ状の等間隔に並べて、それぞれの分離を良くすることで一人ひとりのボーカルがハッキリと聴こえるような配置としている。オケとなるトラックと現場で収録される演者の音声の対比をはっきりさせることで、さらに空間のコントラストをつける試みがなされた。次に会場のアンビエントについてだが、ライブでありながらも無観客、ということも今の状況下のスタジオ収録では課題となる。どのように会場の空気感を演出するかということになるが、会場PAの音を活かすこと、またスタジオ自体は十分な体積と空間が取れているので、後方にアンビエント収録用のマイク( SCHOEPS MK4 )を設置することである程度の空気感を出せるのではないか、とスタジオ後部上方に4箇所アンビエントマイクが設けられている。

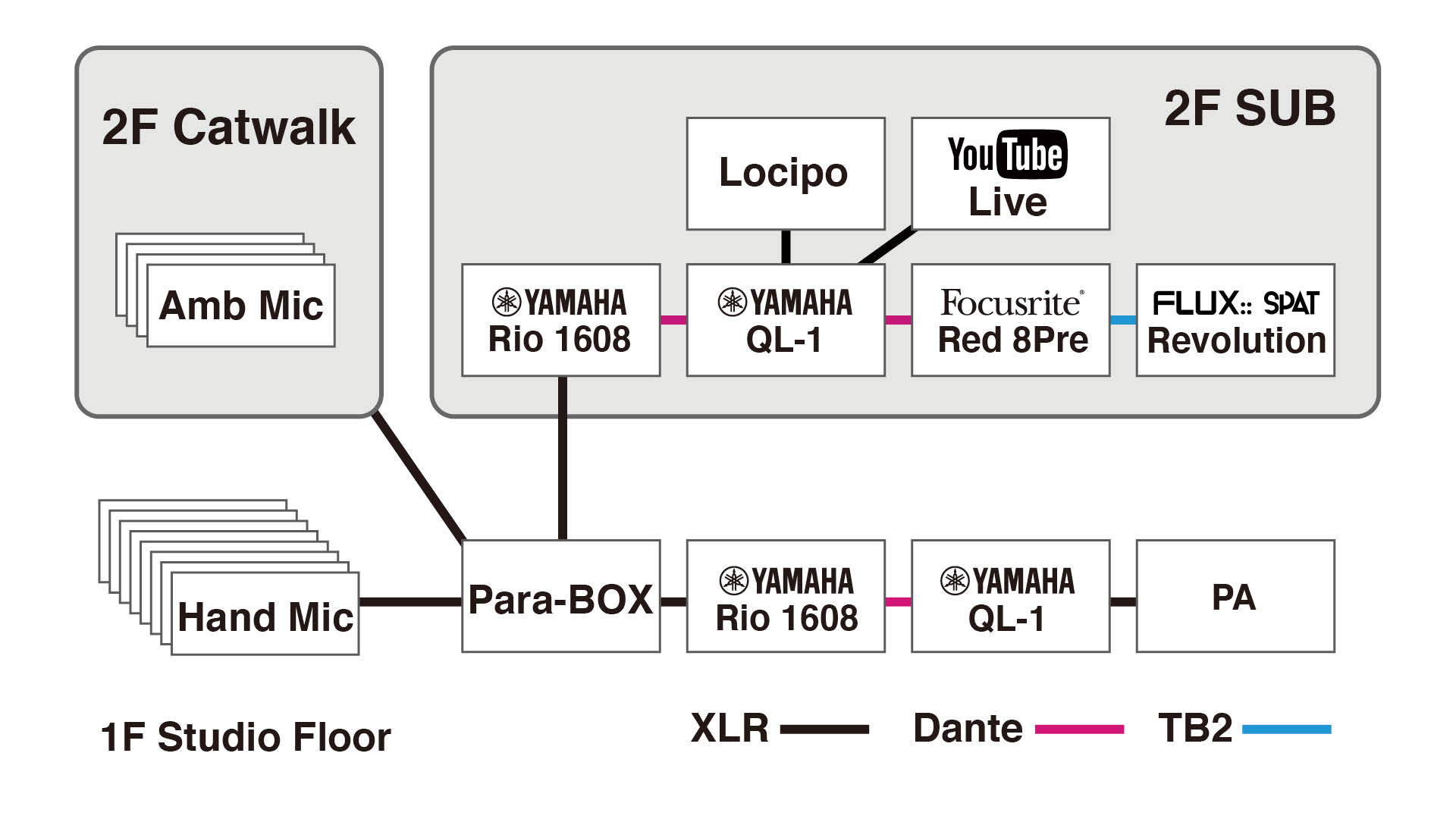

そして配信用のミキサーとのやりとりだが、配信用のミックスにはYamaha QL1が用いられている。そこへ、Focusrite Red 8PreをインターフェースとしたMAC PRO(Late 2013)をDante接続することで、LANケーブル一本でのバイノーラルプロセッシングシステム追加を実現した。

ここで改めて当日のシステム系統を整理する。まず、フロアからの音声をパラボックスで2系統に分割し、1系統はYamaha Rio1608で受けたのち会場PA用のYAMAHA QL1へ、もう1系統はアナログで第一スタジオのサブへと送られる。サブではアナログをYamaha Rio1608で受けたのち、こちらも配信ミックス用のQL1へ入力。ここからDanteの信号をFocusrite Red 8 PRE経由でMAC PROに送っている。Flux SPAT Revolution でバイノーラルプロセッシングを行い、再びDanteでQL1へリターン。QL1から常設のLocipo配信システムと、You Tube Live用のLive Shellへそれぞれ入力し、実際の配信へと音声が乗る仕組みになっている。

なお、You Tube Liveなどのライブ配信プラットフォームでの配信時に、どうしても生じてしまう高音域のロスがある。これは、サービスによっても異なるがそのプラットフォームで採用されている非可逆圧縮方式の音声コーデックの影響によるものだ。例えばAACやMP3といった高圧縮率重視の音声コーデックでは、人間の耳に比較的聴こえにくく、かつ再生に高いビットレートを必要とする15kHz前後から上の帯域をばっさりとフィルターでカットするような処理が行われている。こうして、ある程度の音質を保ちながらも、CD音質比で約90%ものデータ量削減を実現するというメリットはあるものの、トレードオフとなるハイ落ちの問題は避けられない。今回はテスト時からあらかじめハイシェルブのEQで2kHz以上の帯域を3〜6dbほど持ち上げるようにして対応していたが、この点は配信を行う前に事前テストで必ず実際の音声を確認し、解決策を講じておくポイントとなる。

また、今回はライブ中にボーカルマイクの音像定位を動かすということは行なっていない。配信映像は随時スイッチングされていくわけだが、これに合わせてリアルタイムにボーカルのパンニングを行うのは視聴者側も定位が次々と変化していくことになり混乱してしまうからだ。そこで、少しでも映像と音の違和感を無くすためにアイドルたちの基本の立ち位置を考慮してハンドマイクを渡すように管理、誰がどの立ち位置でどのマイクを持つのか、サブの配信ミキサーがフロアアシスタントとインカムで常にやりとりし対応している。また、オペレーションとしても常にボーカルの定位をスイッチングやアイドルたちの動きに合わせていくことは現実的ではないため、今回は前述したようにアーチ状の等間隔に配置したボーカル定位を固定して配信が行われている。むしろ、固定パンとすることできちんと空間を認識することができ、一人一人の声が分離してハッキリ聴こえる結果となるため、違和感を感じることなくコンテンツに没頭できる結果になったのではないだろうか。

配信ライブの需要が増えてきたいま、バイノーラルを取り入れた取り組みはリスナーに新たな発見や感動を伝える重要な機会となっている。今回の試みのように、日々研鑽を重ねる現場の音響技術者達の知恵やアイデアと、メーカーが開発意欲を燃やす最新技術、それらを積極的に取り入れたアーティストの制作意欲、これらが組み合わさって新たな技術トレンドが生まれていくのだろう。

まだまだアツいぞ!! 在名各局のバイノーラル!!●”良いもの”だから使うスタンス / 中京テレビ放送株式会社

中京テレビでは、HPL(HeadPhoneListening)技術を活用したバイノーラルコンテンツのトライアル制作を2019年より行っている。2020年からは4Kや8Kの360°映像も加え、より没入感あふれる次世代コンテンツ制作に取り組んでいるそうだ。トライアルを含めた制作事例としては、2019年3月に地上波「ササシマ MUSIC BASE」 5.1ch放送をバイノーラル化して副音声で放送したのを皮切りに、音楽ライブ素材を使ったヘッドフォン環境での22.2chミキシング、4Kおよび8KVR + 立体音響(22.2ch)、5.1ch→バイノーラルステレオで12時間生配信(!)など、短期間の間に実に多彩な取り組みとなっている。

その中でノウハウも積み重ねられているようだが、やはりスピーカー環境と同様に、HPLをはじめそれぞれのプロセッサーの環境に慣れることでミックスが成立するというのが実感としてあるとのこと。また、基本の2MIX(または5.1ch MIX) とAmbisonicsマイクなどの空間ベースの組み合わせにより放送の延長線上でシステムを組めるという点でも手応えを得ている様子で、3Dオーディオプラグインが増え、DAWを使ってより手軽に立体音響制作ができるようになってきていることも更なる追い風になっているようだ。

表現の拡充、コンテンツの付加価値として効果的であることを技術スタッフ以外も音源を聴いて実感できているとのことで、”真新しいもの”だからではなく、”良いもの”だから使うスタンスでいきたい、とのコメントが印象的。実際に筆者もZoomでのウェビナーと並行して、YouTube Liveにて実際のVR映像を視聴することができたが、バーチャルなライブ会場の中で、巨大なPAスピーカーから音が出ているように感じられ、従来の固定カメラ+ステレオの配信より圧倒的な没入感を体験することができた。こうしたVR+バイノーラル音声でのコンテンツは、今後多くの視聴者にとって、配信ライブにおける付加価値として十分に受け入れられていくのではないだろうか。

●頭外定位で積極的に定位を広げる / メ~テレ(名古屋テレビ放送株式会社)

2020年の夏頃よりバイノーラル制作の事前検証に着手した名古屋テレビ。同年12月に開催された名古屋ギター女子部による、ギタじょぶスペシャルライブ『Live in Re:POP!!』で制作ソリューションを検討することになったそうだ。検証にあたり、ソフト/ハード問わず4種のバイノーラルプロセッサーを比較した上で「低レイテンシーかつ音質変化が少なく自然な音質」との印象から、KLANG:technologiesのKLANG:fabrikを採用している。このKLANG:fabrikは、元々ステージ上のIEM(インイヤーモニター)として開発された製品、昨年サカナクションの配信ライブでも使用されたことで大きな注目を浴びた。

イベント当日、現場でのミキシングのコンセプトとして、実際のステレオMIXの音場より派手で極端なパンニング、会場の響きを感じられるようなアンビエンス感、コーラスのパートでの分離感と立体感、アコースティックギターに包まれているような立体感、という4つのテーマを掲げてセッティング。アンビエンスマイクを会場前方と後方にそれぞれ縦軸向け、横軸向けに設置し、縦軸向けのマイクは4本同じものを使用することで音質的なつながりを重視したり、パンニングを1名だけで行った際に定位感の個人差が生じる可能性を懸念し、2名交代で両者の聴こえ方の中間を取るような工夫を行ったそうだ。

実際のライブ映像は観客による手拍子やアコギの音が、広い空間から包み込まれるように聴こえてくることや、コーラスパートの立体感が特に印象的。ミックスにあたってまず得られたのは、頭外定位させることが可能なのでミキシングの幅を広げることができたとのこと。これは積極的に定位を広げることができることでもあり、立体的な演出表現の可能性を感じさせる。また、今回のアンビエンスマイクは縦軸と横軸を10cm以内のほぼ同軸上に設置し、結果的に時間差を発生させないことで上下配置は自然に感じることができたそうだ。その一方で、頭外定位により分離が良くなるため、ボリューム操作がよりシビアになり緻密なフェーダー操作が必要になるという。フェーダー操作でいかに立体的な音場を作るのか、バイノーラル配信におけるサウンドデザインの鍵も見えてきているのかもしれない。

こちらの 2 局の取り組みについては、AES 日本支部の2021年3月例会「インターネットを用いたライブ配信におけるバイノーラル音声の制作」と題 したウェビナーにて取り上げられ情報共有されている。積極的にバイノーラルに取り組む名古屋の放送各局、得られたノウハウもやはり実践的であり、制作意欲を大いに刺激されるのではないだろうか。

*ProceedMagazine2021号より転載

*記事中に掲載されている情報は2021年08月27日時点のものです。